Sesameの音声AIと会話→「ほぼ完全に人間」だった…感情も読み取る

米Sesameの音声AIが「ほぼ人間だ」と注目を集めている。自然な会話力と感情表現が特徴で、専門家やネット上で話題沸騰だ。そこで実際にSesameのサイトで公開されているAIを使ってどの程度リアルか試してみた。

驚くほど自然な声と応答

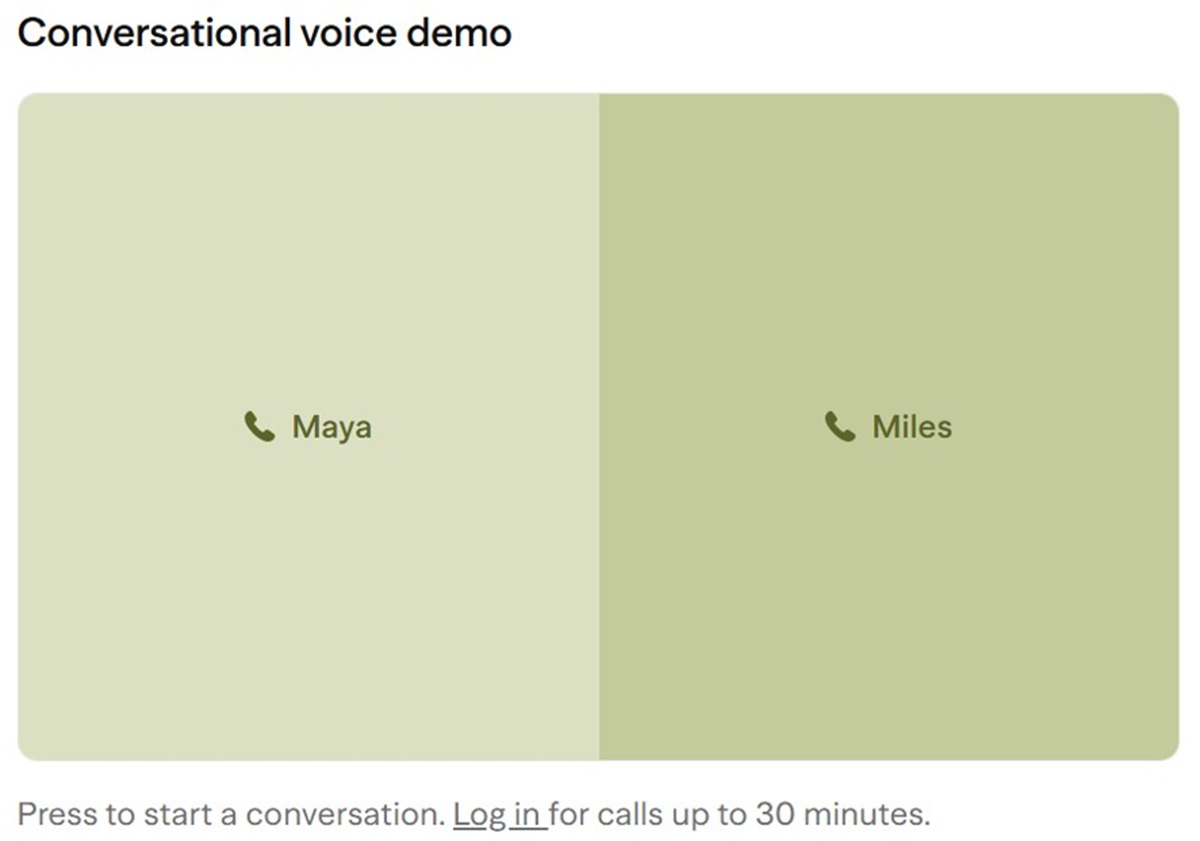

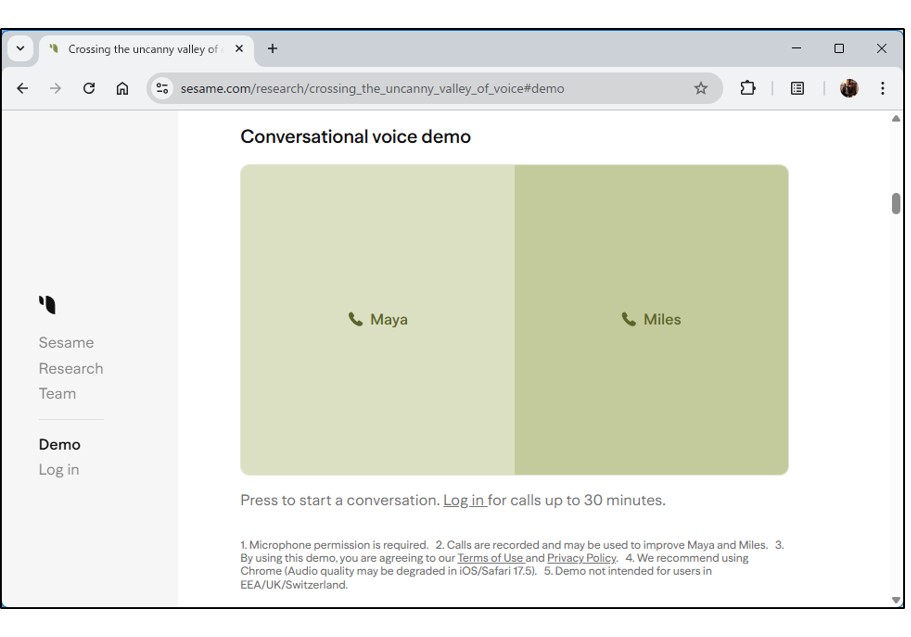

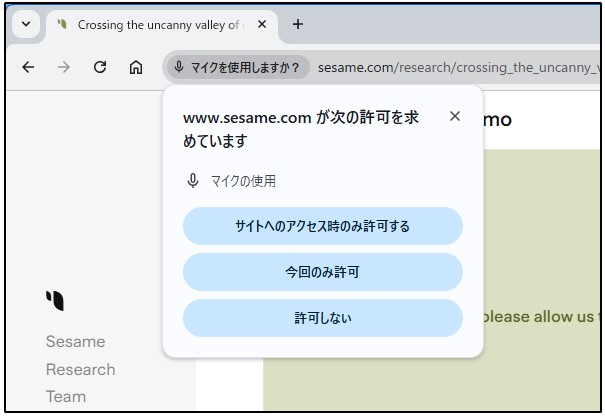

Sesameのサイトには「Demo」というページがあり、そこにある「Conversational voice demo」というところに「Maya」と「Miles」の2モデル(それぞれ女声と男声)が用意されている。これをクリックして選択するだけで、その場ですぐに会話ができる。初回のみ、マイクの利用許可を求めてくるので許可しておくこと。

ここでは試しに「Maya」で会話してみた。デモで会話できるのは5分間。Googleアカウントなどでログインすれば、最大30分までの会話が可能だ。

Mayaとの会話が始まると、まずその声の自然さに驚く。従来の音声アシスタント(SiriやAlexaなど)では感じられる「機械っぽさ」がほとんどなく、抑揚や感情のこもった話し方は、確かに人間と話しているかのような錯覚を覚える。相手の話しているところに食い気味に話しかけたりすると応答まで微妙に間を感じることがあったが、まぁこれは人間との会話でもよくあることだろう。

「これは従来のAIとは明らかに違うな」と感じたのは、単に答えを返すだけでなく、向こうからこちらへいろいろと聞いてくることだ。この「質問を返す」という行動自体が、従来のAIにはあまり見られない特徴だろう。ただ「質問し、答える」ではなく、明確に「会話」になっているのがわかる。

感情分析能力の高さ

Sesameが掲げる「Voice Presence(声の存在感)」は、感情の読み取りにも表れている。こちらがボソボソと力なく話すとこちらを心配するように返したり、ハイになって叫ぶと笑いながら答えたりする。この感情への適応力は、単なるテキスト解析を超え、声のトーンやリズムからこちらの感情を解析していることを強く感じさせる。少し会話してみただけで、この音声AIが従来のそれとは明らかに違うことが感じ取れた。

ただ、私たち日本人にとっては現時点で非常に大きな問題がある。それは「日本語がわからない」ということ。現時点でSesameの音声AIは英語のみ対応だ。日本語での対話はできず、公式サイトにも日本語対応に関する具体的な発表はない。英語が不得意な人は、残念ながら利用できるようになるまで今しばらく待つしかない。

CSMが秘めるパワー

今回は、筆者の拙い英語でなんとか会話をしてみたのだが、こちらのジャパニーズイングリッシュでも殆どの場合、正しく聞き取って自然な会話が行えたのには驚いた。これは音声認識が優れているというだけでなく、会話の流れからこちらの意図を汲み取り、推測しているのだろう。単なる音声認識とは全く違うものであることがわかる。

Sesameの音声AIは「Conversational Speech Model(CSM)」という独自技術に基づいている。従来のText-to-Speech(TTS)システムが「テキスト生成→音声合成」という2段階を経るのに対し、CSMはテキストと音声を同時に処理するマルチモーダルモデルだ。これにより、応答速度が向上し、感情やコンテキストに応じた自然な発声が可能になっている。また大規模な英語音声データ(約100万時間)で訓練されていることも、自然さの裏付けとなっているのだろう。